Krisis Kelangkaan Mac Mini & Mac Studio: Ketika Boom AI OpenClaw Membuat Apple Kewalahan

2 bulan ago · Updated 2 bulan ago

Ada sebuah ironi yang menarik di balik krisis kelangkaan yang sedang melanda dua produk Apple paling ikonik. Mac mini, sebuah komputer desktop mungil yang selama ini dikenal sebagai pilihan terjangkau bagi pengguna yang ingin masuk ke ekosistem macOS, kini mendadak menjadi barang langka yang sulit didapat. Begitu pula Mac Studio komputer desktop bertenaga tinggi yang diposisikan Apple untuk para profesional kreatif. Keduanya mengalami antrean pengiriman yang luar biasa panjang, dan penyebabnya bukan sekadar gangguan rantai pasokan biasa.

Pada Februari 2026, Alex Finn, CEO dari Creator Buddy, sebuah platform alat berbasis AI, memposting sebuah pengamatan yang segera menarik perhatian komunitas teknologi global. Dalam unggahannya di platform X, ia menulis tentang sesuatu yang ia sebut "sesuatu yang besar sedang terjadi" stok Mac mini dan Mac Studio di toko Apple habis terjual, dan waktu tunggu pengiriman melonjak drastis dari yang biasanya 14 hari menjadi 54 hari untuk beberapa konfigurasi.

Pengamatan sederhana itu membuka sebuah diskusi yang jauh lebih luas tentang apa yang sesungguhnya sedang terjadi di persimpangan antara tren kecerdasan buatan lokal, kebutuhan akan komputasi berkapasitas tinggi, dan keterbatasan pasokan chip memori global. Di balik antrean pengiriman yang panjang itu tersembunyi sebuah cerita yang jauh lebih menarik tentang bagaimana AI khususnya AI agent bernama OpenClaw sedang mengubah cara perusahaan dan individu memandang kebutuhan komputasi mereka.

Artikel ini hadir untuk membedah seluruh lapisan dari fenomena ini. Kita akan menelusuri mengapa Mac mini dan Mac Studio menjadi pilihan utama untuk menjalankan AI secara lokal, apa itu OpenClaw dan mengapa popularitasnya begitu berdampak pada penjualan Mac, bagaimana situasi ketersediaan produk saat ini, serta apa implikasinya bagi masa depan komputasi AI di edge langsung di perangkat pengguna, bukan di cloud.

Gambaran Lengkap Kelangkaan: Data dan Fakta di Lapangan

Pengamatan Pertama yang Memicu Kepanikan

Semuanya dimulai dari satu postingan di X. Alex Finn, yang sehari-harinya berkutat dengan alat-alat berbasis AI untuk para kreator konten, memperhatikan sesuatu yang aneh ketika ia mencoba memesan Mac Studio tambahan untuk timnya. Sebulan sebelumnya, ia berhasil mendapatkan dua unit Mac Studio dengan waktu tunggu 14 hari — masih dalam batas wajar untuk produk komputer premium yang dibuat sesuai pesanan. Namun ketika ia mencoba memesan lagi di Februari 2026, waktu tunggu yang tertera sudah melompat ke angka 54 hari.

Bukan hanya Mac Studio yang mengalami masalah ini. Mac mini, yang selama ini dikenal sebagai komputer yang relatif mudah didapat, juga mulai menunjukkan tanda-tanda kelangkaan serupa. Terutama untuk konfigurasi dengan kapasitas RAM di atas level dasar — inilah kunci dari seluruh fenomena ini.

| Pengamatan Alex Finn di Platform X

"Sesuatu yang besar sedang terjadi. Pertama Mac mini. Sekarang Mac Studio. Habis terjual semua. Sebulan lalu saya membeli 2 Mac Studio dengan waktu tunggu 14 hari. Sekarang waktu tunggunya 54 hari." |

Data Waktu Tunggu di Toko Apple Amerika Serikat

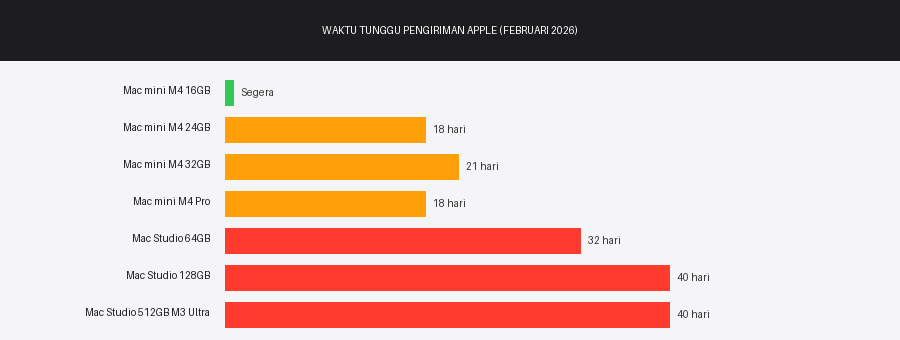

Untuk mendapatkan gambaran yang lebih sistematis, mari kita telaah data waktu tunggu pengiriman yang tercatat di Apple Store Amerika Serikat pada pertengahan Februari 2026. Data ini memberikan gambaran yang sangat jelas tentang pola kelangkaan yang sedang terjadi.

| Model Mac | Konfigurasi RAM | Waktu Tunggu | Status |

| Mac mini M4 | 16GB (base) | Segera tersedia | Normal |

| Mac mini M4 | 24GB | 2-3 minggu | Terbatas |

| Mac mini M4 | 32GB | 2-3 minggu | Terbatas |

| Mac mini M4 Pro | 24GB (base Pro) | Segera tersedia | Normal |

| Mac mini M4 Pro | 48GB / 64GB | 2-3 minggu | Terbatas |

| Mac Studio M4 Max | 64GB | 4-5 minggu | Langka |

| Mac Studio M4 Max | 128GB | 5-6 minggu | Sangat Langka |

| Mac Studio M3 Ultra | 512GB | 5-6 minggu | Sangat Langka |

Data waktu tunggu pengiriman Apple Store AS, Februari 2026. Pola yang jelas terlihat: semakin tinggi kapasitas RAM, semakin panjang antrean pengiriman.

Visualisasi waktu tunggu pengiriman berbagai konfigurasi Mac mini dan Mac Studio — merah menandakan penundaan paling parah, yang mayoritas terjadi pada konfigurasi RAM paling besar.

Pola yang Jelas: RAM adalah Variabel Kunci

Satu hal yang segera terlihat jelas dari data di atas adalah bahwa kelangkaan ini bukan bersifat merata. Konfigurasi dengan RAM dasar atau tingkat terendah masih tersedia untuk pengiriman segera. Masalahnya spesifik pada model-model dengan kapasitas RAM yang lebih tinggi — 24GB ke atas untuk Mac mini, 64GB ke atas untuk Mac Studio.

Ini adalah petunjuk penting. Jika kelangkaan disebabkan oleh masalah produksi umum, semua konfigurasi akan terdampak. Fakta bahwa kelangkaan terpusat pada model berkapasitas RAM tinggi menunjukkan bahwa ada permintaan yang sangat spesifik untuk konfigurasi tersebut — permintaan yang datang dari kelompok pengguna tertentu dengan kebutuhan sangat spesifik pula: mereka yang ingin menjalankan model bahasa besar (Large Language Models atau LLM) secara lokal di perangkat mereka sendiri.

Mengapa Mac mini dan Mac Studio? Keunggulan Arsitektur Apple Silicon

Unified Memory: Kunci Keunggulan untuk AI Lokal

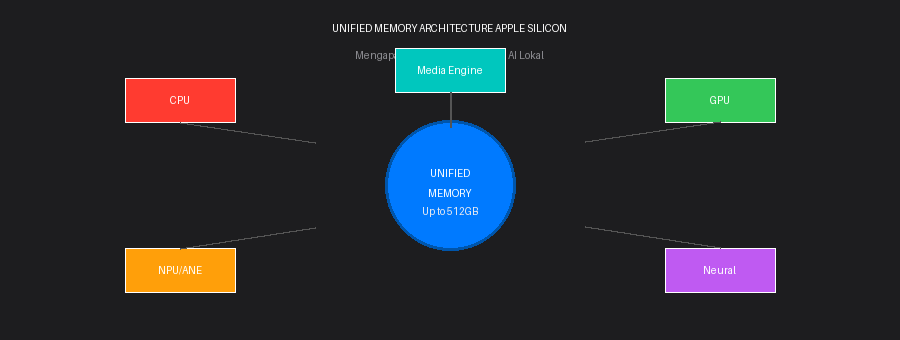

Untuk memahami mengapa Mac mini dan Mac Studio menjadi pilihan favorit untuk menjalankan AI lokal, kita perlu memahami sebuah konsep arsitektur yang membedakan chip Apple Silicon dari chip Intel atau AMD konvensional: Unified Memory Architecture atau UMA.

Dalam komputer konvensional, CPU memiliki RAM-nya sendiri (sistem RAM), dan GPU memiliki memori terpisahnya sendiri (VRAM). Kedua memori ini terletak di chip atau modul fisik yang berbeda, dan data harus ditransfer bolak-balik di antara keduanya ketika aplikasi membutuhkan keduanya. Untuk model AI yang besar, transfer data ini menjadi bottleneck yang signifikan — memperlambat proses inferensi dan meningkatkan konsumsi energi.

Arsitektur Unified Memory Apple Silicon: CPU, GPU, dan Neural Processing Unit (NPU) semuanya berbagi satu pool memori terpusat yang sangat cepat — menjadikannya ideal untuk inferensi model AI yang membutuhkan bandwidth memori tinggi.

Apple Silicon mengubah paradigma ini secara fundamental. Dalam chip M-series Apple, CPU, GPU, dan Neural Processing Unit (NPU atau Apple Neural Engine) semuanya berbagi satu pool memori yang sama — itulah yang disebut Unified Memory. Data tidak perlu dipindahkan antar chip; semuanya bisa diakses secara langsung oleh semua komponen pemrosesan dengan bandwidth yang sangat tinggi.

Konsekuensinya untuk AI lokal sangat dramatis. Sebuah model AI yang berukuran 70 miliar parameter membutuhkan memori yang sangat besar untuk di-load. Di komputer konvensional, Anda mungkin membutuhkan GPU khusus dengan VRAM 48GB atau lebih untuk menjalankan model tersebut dengan performa yang layak. Di Mac Studio dengan 128GB unified memory, seluruh model bisa di-load ke memori dan diakses oleh GPU Apple Silicon dengan bandwidth yang sangat tinggi, menghasilkan kecepatan inferensi yang mengejutkan.

Inilah alasan fundamental mengapa para developer AI dan peneliti mulai melirik Mac mini dan Mac Studio dengan serius. Bukan hanya karena kapasitas memorinya yang besar, tetapi karena memori tersebut bisa digunakan oleh GPU secara langsung tanpa overhead transfer data, menghasilkan throughput yang jauh lebih baik dibandingkan solusi konvensional di harga yang serupa.

Efisiensi Energi yang Luar Biasa

Keunggulan lain Apple Silicon untuk AI lokal adalah efisiensi energinya yang luar biasa. GPU diskret bertenaga tinggi yang digunakan untuk inferensi AI — seperti NVIDIA RTX 4090 atau A100 — mengonsumsi daya ratusan watt. Ini bukan masalah besar jika Anda memiliki infrastruktur server yang sesuai, tetapi sangat tidak praktis untuk penggunaan sehari-hari di kantor atau studio.

Mac mini dengan chip M4 Pro mengonsumsi daya maksimal sekitar 110 watt. Mac Studio dengan M4 Max sekitar 175 watt. Dibandingkan dengan server GPU konvensional yang mungkin mengonsumsi 500-1000 watt untuk performa inferensi yang sebanding, ini adalah efisiensi yang luar biasa. Ini berarti Anda bisa menjalankan AI lokal sepanjang hari di kantor biasa tanpa memerlukan sistem pendingin khusus, instalasi listrik tambahan, atau mengkhawatirkan tagihan listrik yang meledak.

Kluster Mac Studio: Solusi untuk Perusahaan

Salah satu tren yang semakin populer di kalangan perusahaan teknologi, khususnya startup AI dan perusahaan yang membutuhkan komputasi AI on-premise, adalah penggunaan kluster Mac Studio. Alih-alih menginvestasikan jutaan dolar untuk server GPU, perusahaan-perusahaan ini membangun kluster yang terdiri dari beberapa unit Mac Studio yang terhubung melalui jaringan berkecepatan tinggi.

Sebuah kluster 8 unit Mac Studio, masing-masing dengan 128GB unified memory, memberikan total kapasitas memori 1TB yang bisa digunakan untuk menjalankan model-model AI yang sangat besar. Dengan biaya sekitar $150.000 untuk seluruh kluster, ini jauh lebih terjangkau dibandingkan alternatif server GPU yang sebanding — yang bisa mencapai $500.000 hingga beberapa juta dolar.

Tom's Hardware melaporkan bahwa ada "growing number of companies yang menggunakan clusters and clusters of Mac Studios" yang "perfect for long-running agentic tasks and local private LLMs." Ini adalah salah satu faktor terbesar yang mendorong permintaan — bukan hanya individu yang membeli satu unit Mac mini, tetapi perusahaan yang memesan puluhan atau bahkan ratusan Mac Studio sekaligus.

OpenClaw: Fenomena AI Agent yang Mengubah Segalanya

Apa Itu OpenClaw?

Di pusat dari fenomena permintaan Mac ini ada sebuah nama yang mungkin belum akrab di telinga banyak orang awam, tetapi sudah sangat dikenal di komunitas AI developer: OpenClaw. OpenClaw adalah sebuah AI agent — sebuah sistem kecerdasan buatan yang tidak hanya mampu menjawab pertanyaan seperti chatbot biasa, tetapi juga mampu melakukan serangkaian tindakan secara otonom untuk mencapai tujuan yang diberikan pengguna.

AI agent seperti OpenClaw mewakili generasi berikutnya dari kecerdasan buatan praktis. Berbeda dengan model chatbot konvensional yang hanya merespons satu pertanyaan dalam satu waktu, AI agent bisa "berpikir" dalam langkah-langkah, membuat rencana, mengeksekusi tindakan, mengevaluasi hasilnya, dan menyesuaikan pendekatannya secara dinamis. Mereka bisa menulis kode, mengelola file, berinteraksi dengan aplikasi, dan bahkan mengoordinasikan tugas-tugas kompleks yang membutuhkan ratusan langkah pengambilan keputusan.

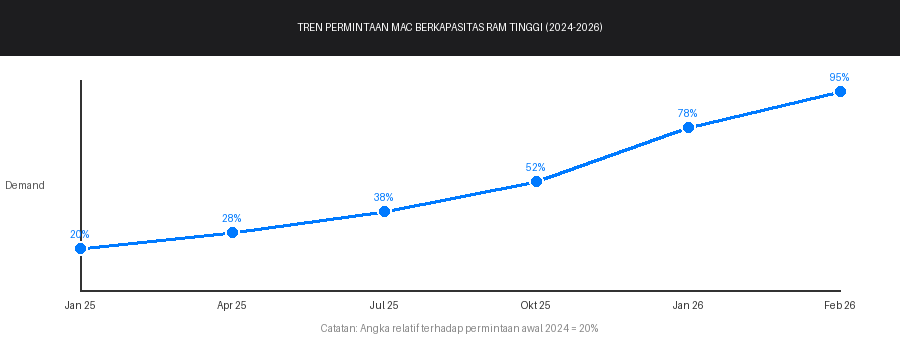

Tren permintaan Mac berkapasitas RAM tinggi yang meningkat drastis sejak 2024, dengan akselerasi tajam di awal 2026 seiring meledaknya popularitas OpenClaw dan AI agent serupa.

Mengapa OpenClaw Membutuhkan Hardware Lokal?

Pertanyaan yang wajar adalah: mengapa menjalankan OpenClaw dan AI agent serupa secara lokal, padahal ada banyak layanan cloud AI yang sudah tersedia? Jawabannya terdiri dari beberapa dimensi yang saling melengkapi.

Pertama, ada dimensi privasi yang sangat krusial bagi banyak perusahaan. Ketika Anda menjalankan AI agent melalui cloud, semua data yang diproses oleh agent tersebut — dokumen, kode, email, strategi bisnis, data pelanggan — semuanya melewati server pihak ketiga. Untuk perusahaan yang beroperasi di industri yang sangat diatur seperti layanan kesehatan, keuangan, atau hukum, ini adalah risiko kepatuhan yang tidak bisa diterima.

Kedua, ada masalah biaya yang menjadi sangat signifikan ketika AI agent digunakan secara intensif. Layanan cloud AI dikenakan biaya berdasarkan jumlah token yang diproses. Sebuah AI agent yang berjalan secara aktif sepanjang hari bisa memproses jutaan token setiap harinya, menghasilkan tagihan cloud yang sangat besar. Dengan hardware lokal, biaya ini menjadi satu kali investasi di awal.

Ketiga, latensi jaringan bisa menjadi masalah serius untuk tugas-tugas yang membutuhkan respons cepat. AI agent yang mengelola sistem real-time, berinteraksi dengan pengguna secara langsung, atau memproses data yang mengalir terus-menerus membutuhkan inferensi yang cepat dan konsisten. Jaringan internet yang tidak stabil bisa mengganggu kinerja secara signifikan.

Keempat dan mungkin yang paling menarik: kebebasan untuk memilih dan mengkustomisasi model. Ketika Anda menggunakan layanan cloud AI, Anda terbatas pada model yang disediakan oleh provider tersebut. Dengan infrastruktur lokal, Anda bisa menjalankan model open-source apa pun yang Anda pilih — termasuk model-model khusus yang telah di-fine-tune untuk domain tertentu, atau bahkan model yang Anda latih sendiri.

Ekosistem AI Lokal yang Berkembang Pesat

OpenClaw tidak sendirian. Popularitasnya mencerminkan dan sekaligus mendorong pertumbuhan ekosistem yang jauh lebih luas dari tools dan framework untuk menjalankan AI secara lokal. Ollama, LM Studio, Jan.ai, AnythingLLM, dan puluhan tools serupa telah memudahkan siapa pun — bahkan mereka yang tidak memiliki latar belakang teknis mendalam — untuk menjalankan model-model AI canggih langsung di komputer mereka.

Framework seperti LangChain dan LlamaIndex menyediakan abstraksi tingkat tinggi untuk membangun aplikasi berbasis LLM, sementara model-model open-source seperti Meta Llama, Mistral, Qwen, dan DeepSeek menyediakan "otak" yang semakin kuat dengan setiap iterasi baru. Komunitas open-source AI bergerak dengan kecepatan yang mengagumkan — model baru dengan kemampuan yang semakin canggih dirilis hampir setiap minggu.

Di tengah ekosistem yang berkembang dengan kecepatan luar biasa ini, Mac mini dan Mac Studio dengan unified memory besar muncul sebagai platform hardware yang paling menarik untuk menjalankan semua tools ini. Apple Silicon memberikan kombinasi yang sulit ditandingi: kapasitas memori yang besar, bandwidth memori yang tinggi, efisiensi energi yang luar biasa, dan form factor yang kompak serta senyap — semuanya dalam satu paket yang relatif terjangkau.

AI Cloud versus AI Lokal: Sebuah Perbandingan yang Adil

Perbandingan komprehensif antara penggunaan AI berbasis cloud versus AI lokal menggunakan Mac mini atau Mac Studio — masing-masing memiliki kelebihan dan kekurangan yang perlu dipertimbangkan sesuai kebutuhan.

Keunggulan dan Keterbatasan AI Cloud

Sebelum kita terlalu antusias tentang AI lokal, penting untuk memberikan gambaran yang adil tentang apa yang ditawarkan oleh layanan AI cloud. Model-model terbaik yang tersedia melalui cloud — GPT-4o dari OpenAI, Claude Sonnet dari Anthropic, Gemini Ultra dari Google — masih berada di atas sebagian besar model open-source yang tersedia untuk dijalankan secara lokal dalam hal kemampuan pemahaman bahasa, penalaran kompleks, dan kinerja umum.

Selain kemampuan model yang superior, AI cloud juga menawarkan kemudahan setup yang tidak bisa diabaikan. Untuk memulai menggunakan GPT-4 via API, Anda hanya perlu mendaftar, mendapatkan API key, dan mulai memanggil API — prosesnya bisa diselesaikan dalam hitungan menit. Tidak ada hardware yang perlu dikonfigurasi, tidak ada driver yang perlu diinstal, tidak ada model yang perlu diunduh dan dimuat.

Skalabilitas juga menjadi keunggulan utama cloud. Jika kebutuhan komputasi Anda tiba-tiba melonjak — misalnya karena produk Anda viral dan ratusan ribu pengguna baru berbondong-bondong menggunakan AI agent Anda — infrastruktur cloud bisa menyesuaikan diri secara otomatis. Hardware lokal yang terbatas tidak bisa melakukan ini.

Mengapa AI Lokal Semakin Menarik

Namun tren yang sedang terjadi menunjukkan bahwa keunggulan-keunggulan AI cloud ini semakin tidak absolut. Model open-source telah berkembang dengan kecepatan yang mengejutkan. Model seperti DeepSeek-R1, Llama 3.1 405B, dan Qwen 2.5 kini mampu mengimbangi atau bahkan melampaui model-model cloud terbaik dalam banyak benchmark dan tugas praktis.

Kesenjangan kemampuan yang dulu sangat besar antara model cloud premium dan model lokal terbaik kini semakin menyempit dengan setiap siklus rilis baru. Dengan tren ini, argumen "model cloud jauh lebih baik" akan semakin lemah dalam 12-24 bulan ke depan, sementara argumen "AI lokal lebih privat, lebih murah, dan lebih terkontrol" akan tetap kuat.

Inilah yang membuat gelombang permintaan Mac berkapasitas RAM tinggi ini begitu menarik untuk diamati. Ini bukan sekadar tren sesaat. Ini adalah sinyal bahwa paradigma komputasi AI sedang bergeser — dari model terpusat berbasis cloud menuju model terdistribusi di mana lebih banyak komputasi AI terjadi langsung di perangkat pengguna.

Krisis RAM Global: Konteks yang Memperberat Situasi

Permintaan Chip Memori yang Melampaui Pasokan

Untuk memahami mengapa Apple kesulitan memenuhi lonjakan permintaan ini, kita perlu melihat gambaran yang lebih luas tentang industri semikonduktor global, khususnya pasar chip memori. Boom AI yang terjadi sejak 2023 telah menciptakan permintaan yang luar biasa besar untuk chip memori — tidak hanya untuk Mac Apple, tetapi untuk seluruh industri komputasi.

GPU NVIDIA yang digunakan untuk melatih dan menjalankan model AI besar membutuhkan chip HBM (High Bandwidth Memory) dalam jumlah yang sangat besar. SK Hynix, Samsung, dan Micron — tiga produsen HBM terbesar di dunia — telah mengalihkan sebagian besar kapasitas produksi mereka untuk memenuhi permintaan yang datang dari Google, Microsoft, Meta, Amazon, dan tentu saja NVIDIA. Akibatnya, pasokan chip memori untuk produk konsumen — termasuk Mac Apple — menjadi lebih terbatas.

Apple menggunakan jenis memori yang berbeda (LPDDR5X, bukan HBM) untuk Mac-nya, tetapi tekanan supply chain yang sama tetap terasa. Setiap gigabyte memori yang masuk ke server AI di pusat data Google adalah satu gigabyte yang tidak tersedia untuk Mac Studio di pabrik Apple.

Proyeksi Harga ke Depan

Jika tren ini berlanjut, implikasinya bagi konsumen sangat jelas: Mac dengan kapasitas RAM tinggi akan semakin mahal. Harga unified memory Apple sudah sangat premium dibandingkan dengan RAM konvensional di komputer Windows — $200 untuk upgrade dari 16GB ke 24GB di Mac mini adalah contoh yang sering dikritik. Dengan tekanan pasokan yang semakin kuat, harga-harga ini kemungkinan tidak akan turun dalam waktu dekat.

Analis industri memperkirakan bahwa harga chip memori premium akan terus meningkat setidaknya hingga 2027, ketika kapasitas produksi baru dari pabrik-pabrik Samsung dan SK Hynix yang sedang dibangun di Korea Selatan dan Amerika Serikat mulai beroperasi. Hingga saat itu, konsumen yang ingin membeli Mac mini atau Mac Studio dengan RAM besar mungkin harus bersiap untuk membayar lebih mahal dan menunggu lebih lama.

Implikasi Lebih Luas: Apa Artinya Ini Semua?

Sinyal Pergeseran Paradigma Komputasi

Kelangkaan Mac mini dan Mac Studio yang sedang terjadi bukan sekadar masalah supply chain yang akan berlalu begitu saja. Ini adalah gejala dari sesuatu yang jauh lebih fundamental: sebuah pergeseran paradigma dalam cara komputasi AI dilakukan dan di mana ia terjadi.

Selama beberapa tahun terakhir, narasi dominan di industri AI adalah "cloud is king." Semua komputasi AI terjadi di pusat data raksasa milik Google, Amazon, Microsoft, atau OpenAI. Pengguna hanya perlu memiliki koneksi internet dan kartu kredit. Tetapi narasi ini sedang ditantang secara serius oleh gerakan AI lokal yang semakin kuat.

Kelangkaan Mac ini adalah bukti nyata bahwa gerakan tersebut bukan sekadar wacana akademis di forum Reddit atau komunitas developer. Ini adalah fenomena nyata yang sudah cukup besar untuk berdampak pada rantai pasokan perusahaan terbesar di dunia.

Implikasi bagi Apple

Bagi Apple, krisis kelangkaan ini mengandung berita baik dan berita yang perlu direspons. Kabar baiknya: Mac mini dan Mac Studio — dua produk yang secara historis bukan produk volume tertinggi Apple — tiba-tiba menjadi sangat diminati oleh segmen pasar yang baru dan sangat loyal: komunitas AI developer.

Ini adalah validasi luar biasa dari keputusan desain Apple untuk mengimplementasikan Unified Memory Architecture dalam chip M-series mereka. Keputusan yang awalnya dikritik karena membatasi kemampuan pengguna untuk mengupgrade RAM sendiri ternyata menjadi keunggulan kompetitif yang sangat signifikan dalam era AI lokal.

Namun Apple juga perlu merespons dengan memperkuat rantai pasokan untuk komponen memori kapasitas tinggi. Jika antrean pengiriman yang panjang ini berlanjut terlalu lama, beberapa pembeli potensial — terutama perusahaan yang perlu membuat keputusan cepat — mungkin akan beralih ke alternatif lain, seperti workstation Linux berbasis GPU NVIDIA.

Implikasi bagi Konsumen dan Developer

Bagi konsumen dan developer yang sedang mempertimbangkan investasi di hardware AI lokal, situasi saat ini mengandung pesan yang cukup jelas: jangan menunggu terlalu lama. Jika Anda sudah memutuskan bahwa Mac mini atau Mac Studio dengan RAM besar adalah investasi yang tepat untuk kebutuhan AI Anda, waktu terbaik untuk memesannya adalah sekarang — sebelum antrean semakin panjang dan harga kemungkinan semakin meningkat.

Untuk perusahaan yang sedang merencanakan infrastruktur AI on-premise, pertimbangkan untuk memasukkan faktor lead time yang lebih panjang dalam perencanaan Anda. Antrean 5-6 minggu untuk Mac Studio konfigurasi tertinggi berarti Anda perlu memesan jauh sebelum proyek Anda dimulai.

Kesimpulan: Komputer Kecil di Pusaran Revolusi AI

Mac mini adalah komputer yang selalu meremehkan ukurannya sendiri. Sejak pertama kali diperkenalkan Steve Jobs pada tahun 2005 dalam sebuah kotak kecil yang ia keluarkan dari kantong, Mac mini telah berulang kali membuktikan bahwa ukuran bukan penentu kemampuan. Tetapi tidak ada yang bisa memprediksi bahwa dua puluh satu tahun kemudian, komputer mungil ini akan menjadi salah satu platform paling diminati di tengah revolusi kecerdasan buatan.

Kelangkaan yang sedang terjadi adalah cerminan dari sebuah momen yang sangat penting dalam sejarah komputasi. Ini adalah momen ketika AI mulai "turun" dari menara cloud yang tinggi dan masuk ke ruang kerja, studio, dan kantor sehari-hari — di dalam sebuah kotak kecil bertenaga besar yang bisa ditempatkan di sudut meja.

OpenClaw dan tools AI agent serupa hanyalah awal. Seiring model open-source terus berkembang dan semakin mendekati kemampuan model cloud premium, gelombang adopsi AI lokal akan semakin besar. Dan Apple, dengan Unified Memory Architecture yang brilian, secara tidak sengaja telah memposisikan dirinya di garis terdepan dari pergeseran paradigma ini.

Apakah krisis kelangkaan ini akan berlanjut? Kemungkinan besar ya, setidaknya dalam jangka pendek. Apakah harga akan naik? Hampir pasti. Apakah tren AI lokal akan terus menguat? Berdasarkan semua indikator yang ada, jawabannya adalah ya. Dan di tengah semua ketidakpastian itu, satu hal tetap jelas: Mac mini yang "kecil" itu ternyata menyimpan potensi yang jauh lebih besar dari yang pernah kita bayangkan.

FAQ – Mac mini & Mac Studio Langka karena Booming OpenClaw AI

1. Mengapa Mac mini dan Mac Studio mulai langka?

Kelangkaan terjadi terutama pada konfigurasi dengan RAM besar. Lonjakan permintaan datang dari developer dan perusahaan yang ingin menjalankan AI lokal (LLM dan AI agent) langsung di perangkat, bukan di cloud.

2. Apa hubungannya OpenClaw dengan kelangkaan ini?

OpenClaw adalah AI agent yang populer untuk menjalankan tugas kompleks secara otonom. Banyak pengguna memilih menjalankannya secara lokal demi privasi, kontrol, dan efisiensi biaya — sehingga membutuhkan Mac dengan kapasitas RAM tinggi.

3. Mengapa Mac mini dan Mac Studio cocok untuk AI lokal?

Karena keduanya menggunakan Apple Silicon dengan Unified Memory Architecture, di mana CPU, GPU, dan Neural Engine berbagi satu pool memori berkecepatan tinggi. Ini membuat inferensi model AI lebih efisien dibanding sistem dengan RAM dan VRAM terpisah.

Model yang paling diminati saat ini adalah:

-

Mac mini

-

Mac Studio

4. Apakah semua model mengalami kelangkaan?

Tidak. Model dengan RAM dasar (16GB atau 24GB base) biasanya masih tersedia. Kelangkaan paling parah terjadi pada konfigurasi 32GB ke atas untuk Mac mini, dan 64GB hingga 128GB untuk Mac Studio.

5. Apakah ini murni karena AI lokal?

Tidak sepenuhnya. Selain booming AI lokal, ada juga tekanan pada pasokan chip memori global. Permintaan RAM meningkat secara keseluruhan akibat pertumbuhan industri AI dan server data center.

6. Mengapa perusahaan membeli banyak Mac Studio sekaligus?

Beberapa perusahaan membangun cluster Mac Studio untuk menjalankan LLM privat atau AI agent jangka panjang. Solusi ini lebih hemat dibanding server GPU mahal dan lebih efisien dalam konsumsi daya.

7. Apakah harga Mac dengan RAM besar akan naik?

Kemungkinan besar ya, terutama jika permintaan terus meningkat dan pasokan chip memori tetap terbatas. Konfigurasi RAM besar sudah premium, dan tekanan pasar bisa membuatnya semakin mahal.

8. Apakah AI cloud masih lebih baik daripada AI lokal?

AI cloud seperti GPT atau Claude masih unggul dalam beberapa aspek. Namun AI lokal menawarkan:

-

Privasi penuh

-

Biaya jangka panjang lebih rendah

-

Kontrol model lebih fleksibel

-

Tidak bergantung pada koneksi internet

Karena itu, banyak developer mulai beralih atau mengombinasikan keduanya.

9. Apakah kelangkaan ini akan berlangsung lama?

Jika tren AI lokal terus meningkat, kemungkinan kelangkaan akan bertahan dalam jangka pendek hingga menengah. Situasi sangat bergantung pada produksi chip memori global dan strategi Apple dalam meningkatkan pasokan.

10. Haruskah membeli sekarang atau menunggu?

Jika Anda memang membutuhkan Mac dengan RAM besar untuk AI lokal, membeli lebih cepat bisa menghindari antrean lebih panjang dan potensi kenaikan harga. Namun jika kebutuhan belum mendesak, menunggu bisa memberi opsi model generasi berikutnya.

Tinggalkan Balasan